Nieregularny upadek samolotu wśród akrobacji. Akrobacje z nazwami. Wykonanie manewru akrobacyjnego „Dead Loop”

Przeczytaj także

Obecnie każdy miłośnik wideo ma możliwość stworzenia własnego domowego studia wideo w oparciu o swój komputer osobisty. Wiadomo, że podczas pracy z plikami wideo istnieje potrzeba przetworzenia i przechowywania bardzo dużej ilości informacji, np. jednej minuty cyfrowego sygnału wideo o rozdzielczości SIF (porównywalnej z VHS) i prawdziwym kolorze (miliony kolorów). zajmie (288 x 358) pikseli x 24 bity x 25 klatek/s x 60 s = 442 MB, czyli na nośniku używanym we współczesnych komputerach PC, takim jak płyta CD (CD-ROM, około 650 MB) lub dysk twardy ( kilkadziesiąt gigabajtów), aby zapisać pełnoetatowe nagrane wideo. W tym formacie nie będzie działać. Stosując kompresję MPEG, można znacznie zmniejszyć głośność informacji wideo bez zauważalnej degradacji obrazu. Jak działa MPEG i jakie ma inne zastosowania, zostanie omówione dalej.

MPEG-a

Słowo MPEG jest skrótem od Moving Picture Expert Group, nazwy grupy ekspertów ISO, która pracuje nad opracowaniem standardów kodowania i kompresji danych wideo i audio. Oficjalna nazwa grupy to ISO/IEC JTC1 SC29 WG11. Często akronim MPEG jest używany w odniesieniu do standardów opracowanych przez tę grupę. Obecnie znane są:

- MPEG-1 przeznaczony jest do nagrywania zsynchronizowanego wideo (zwykle w formacie SIF, 288 x 358) i audio na CD-ROM, biorąc pod uwagę maksymalna prędkość odczyt około 1,5 Mbit/s. Parametry jakościowe danych wideo przetwarzanych w formacie MPEG-1 są pod wieloma względami podobne do konwencjonalnego wideo VHS, dlatego format ten znajduje zastosowanie przede wszystkim tam, gdzie niewygodne lub niepraktyczne jest stosowanie standardowych analogowych nośników wideo.

- MPEG-2 przeznaczony jest do przetwarzania obrazów wideo o jakości porównywalnej z telewizją przepustowość łącza systemy transmisji danych wahają się od 3 do 15 Mbit/s, a w sprzęcie profesjonalnym wykorzystują strumienie o prędkościach do 50 Mbit/s. Wiele kanałów telewizyjnych przechodzi na technologie oparte na formacie MPEG-2; sygnał skompresowany zgodnie z tym standardem jest nadawany za pośrednictwem satelitów telewizyjnych i służy do archiwizacji dużych ilości materiału wideo.

- MPEG-3 – przeznaczony do użytku w systemach telewizji wysokiej rozdzielczości (HDTV) z szybkością transmisji danych 20–40 Mbit/s, ale później stał się częścią standardu MPEG-2 i nie jest już wymieniany osobno. Nawiasem mówiąc, format MP3, czasami mylony z MPEG-3, jest przeznaczony wyłącznie do kompresji dźwięku, a pełna nazwa MP3 to MPEG-Audio Layer-3.

- MPEG-4 definiuje zasady pracy z cyfrową reprezentacją danych medialnych dla trzech obszarów: multimediów interaktywnych (w tym produktów dystrybuowanych na dyskach optycznych i przez Internet), aplikacji graficznych (treści syntetyczne) oraz telewizji cyfrowej.

JAK WYSTĘPUJE KOMPRESJA

Podstawowym obiektem kodującym w standardzie MPEG jest klatka obrazu telewizyjnego. Ponieważ w większości scen tło obrazu pozostaje w miarę stabilne, a akcja toczy się tylko na pierwszym planie, kompresję rozpoczyna się od utworzenia oryginalnej klatki. Klatki początkowe (wewnątrzklatkowe) są kodowane wyłącznie przy użyciu kompresji wewnątrzklatkowej przy użyciu algorytmów podobnych do tych stosowanych w formacie JPEG. Ramka jest podzielona na bloki o wymiarach 8x8 pikseli. W każdym bloku przeprowadzana jest dyskretna transformata kosinusowa (DCT), po której następuje kwantyzacja uzyskanych współczynników. Ze względu na dużą przestrzenną korelację jasności pomiędzy sąsiednimi pikselami obrazu, DCT prowadzi do koncentracji sygnału w dolnoczęstotliwościowej części widma, który po kwantyzacji jest skutecznie kompresowany za pomocą kodowania o zmiennej długości. Przewidywane ramki są przetwarzane przy użyciu przewidywania w przód z poprzednich oryginalnych lub przewidywalnych klatek. Klatka jest podzielona na makrobloki o wymiarach 16×16 pikseli, każdemu makroblokowi przypisany jest najbardziej podobny fragment obrazu z ramki odniesienia, przesunięty o wektor przemieszczenia. Ta procedura nazywa się analizą ruchu i kompensacją. Dopuszczalny stopień kompresji dla klatek przewidywalnych jest 3 razy większy niż możliwy dla klatek oryginalnych. W zależności od charakteru obrazu wideo klatki interpolowane dwukierunkowo są kodowane na jeden z czterech sposobów: predykcja do przodu; predykcja odwrotna z kompensacją ruchu – stosowana, gdy w zakodowanej ramce pojawiają się nowe obiekty obrazu; dwukierunkowe przewidywanie z kompensacją ruchu; przewidywanie wewnątrzklatkowe – kiedy następuje nagła zmiana sceny lub kiedy wysoka prędkość ruchome elementy obrazu. Klatki dwukierunkowe kojarzą się z najgłębszą kompresją danych wideo, jednak ponieważ wysoki stopień kompresji zmniejsza dokładność rekonstrukcji oryginalnego obrazu, klatki dwukierunkowe nie są wykorzystywane jako klatki referencyjne. Gdyby współczynniki DCT zostały przesłane prawidłowo, zrekonstruowany obraz byłby całkowicie identyczny z oryginałem. Błędy w rekonstrukcji współczynników DCT związane z kwantyzacją prowadzą jednak do zniekształceń obrazu. Im grubsza jest kwantyzacja, tym mniejsza jest objętość zajmowana przez współczynniki i tym silniejsza jest kompresja sygnału, ale także większe zniekształcenie wizualne.

Ze względu na fakt, że MPEG jest opracowywany przez tak autorytatywną organizację jak ISO i jest dość metoda uniwersalna kompresji (może być stosowana w nagraniach wideo, transmisjach telewizyjnych, montażu wideo w domu, programach multimedialnych (edukacyjnych, gamingowych), telekonferencjach, tworzeniu filmów do prezentacji w Internecie), stała się dominującym standardem cyfrowej kompresji wideo, eliminując potrzebę używać wielu niezgodnych metod kompresji wideo, które istniały wcześniej.

Jak działa wideo MPEG

Kolorowy obraz cyfrowy ze skompresowanej sekwencji jest konwertowany na przestrzeń kolorów YUV (YCbCr). Składnik Y reprezentuje intensywność, a U i V reprezentują nasycenie. Ponieważ ludzkie oko jest mniej wrażliwe na kolor niż na jego intensywność, rozdzielczość składników koloru można zmniejszyć dwukrotnie w pionie lub zarówno w pionie, jak i w poziomie. W przypadku animacji i wysokiej jakości filmów studyjnych redukcja rozdzielczości nie jest stosowana w celu zachowania jakości, ale w celu użytku domowego, gdzie przepływy są mniejsze, a sprzęt tańszy, takie działanie nie prowadzi do zauważalne straty w percepcji wzrokowej, zachowując jednocześnie cenne fragmenty danych.

Podstawową ideą całego schematu jest przewidzenie ruchu od klatki do klatki, a następnie zastosowanie dyskretnej transformaty kosinusowej (DCT) w celu redystrybucji redundancji w przestrzeni. DCT realizowany jest na blokach o wymiarach 8x8 pikseli, predykcja ruchu realizowana jest na kanale intensywności (Y) na blokach o wymiarach 16x16 pikseli lub w zależności od charakterystyki oryginalnej sekwencji obrazów (przeplot, zawartość) na blokach o wymiarach 16x8 pikseli. Innymi słowy, dany blok pikseli 16x16 w bieżącej klatce jest wyszukiwany w odpowiadającym mu większym obszarze w poprzednich lub kolejnych klatkach. Współczynniki DCT (dane oryginalne lub różnica między tym blokiem a odpowiadającym mu blokiem) są kwantowane, to znaczy dzielone przez określoną liczbę w celu odrzucenia nieistotnych bitów. Wiele współczynników po takiej operacji okazuje się zerowych. Współczynnik kwantyzacji można zmienić dla każdego „makrobloku” (makroblok to blok 16x16 punktów składowych Y i odpowiadające im bloki 8x8 w przypadku stosunku YUV 4:2:0, 16x8 w przypadku 4: 2:2 i 16x16 w przypadku 4:4:4 Współczynniki DCT, parametry kwantyzacji, wektory ruchu itp. kodowane są przy użyciu ustalonych przez normę tablic. Zakodowane dane dodawane są do pakietów, które tworzą strumień wg Składnia MPEG.

Współczynnik klatek i typy

Istnieją trzy typy zakodowanych ramek. Ramki I to klatki zakodowane jako nieruchome obrazy - bez odniesienia do kolejnych lub poprzednich. Używane są jako startery. Ramki P to ramki przewidywane na podstawie poprzednich klatek I lub P. Każdy makroblok w ramce P może pochodzić z wektora i różnicy współczynników DCT z odpowiedniego bloku ostatniego zdekodowanego I lub P, lub może być zakodowany jak w I, jeśli nie zostanie znaleziony odpowiedni blok.

Wreszcie istnieją ramki B, które są przewidywane na podstawie dwóch najbliższych klatek I lub P, jednej poprzedniej i jednej kolejnej. W tych ramkach wyszukiwane są pasujące bloki i wybierany jest najlepszy. Przeszukiwany jest wektor do przodu, następnie odwrotny i obliczana jest średnia pomiędzy odpowiednimi makroblokami w przeszłości i przyszłości. Jeśli to nie zadziała, wówczas blok można zakodować jak w ramce I.

Zwykle wygląda sekwencja zdekodowanych klatek

I B B P B B P B B P B B I B B P B B P B ...

Od klatki I do klatki I jest 12 klatek. Opiera się to na wymogu dostępu swobodnego, zgodnie z którym punkt początkowy jest powtarzany co 0,4 sekundy. Relacja pomiędzy P i B opiera się na doświadczeniu.

Aby dekoder działał, pierwsza ramka P w strumieniu musi spotkać się przed pierwszą ramką B, zatem skompresowany strumień wygląda następująco:

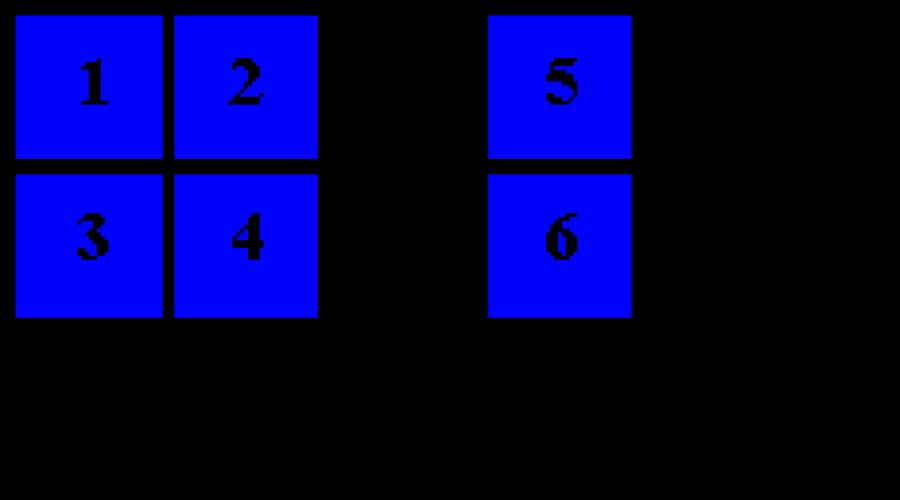

0 x x 3 1 2 6 4 5 ...

gdzie liczby są numerami klatek. xx może być niczym, jeśli jest początkiem sekwencji, lub ramkami B -2 i -1, jeśli jest to fragment ze środka strumienia.

Najpierw należy zdekodować ramkę I, następnie ramkę P, a następnie, mając obie w pamięci, należy zdekodować ramkę B. Podczas dekodowania ramki P, wyświetlana jest ramka I, natychmiast wyświetlane są ramki B, a zdekodowane P jest wyświetlane podczas dekodowania następnej klatki.

Algorytm kompresji dźwięku MPEG

Kompresja dźwięku wykorzystuje wysoko rozwinięte modele psychoakustyczne pochodzące z eksperymentów z najbardziej wymagającymi słuchaczami, aby wyeliminować dźwięki niesłyszalne dla ludzkiego ucha. Nazywa się to „maskowaniem”. Na przykład duża składowa na pewnej częstotliwości uniemożliwia usłyszenie składowych o niższym współczynniku na pobliskich częstotliwościach, gdzie związek między energiami maskowanych częstotliwości opisuje pewna krzywa empiryczna. Istnieją podobne efekty maskowania czasowego, a także bardziej złożone interakcje, w których efekt czasowy może uwypuklić częstotliwość i odwrotnie.

Dźwięk rozkładany jest na bloki widmowe za pomocą obwodu hybrydowego, który łączy w sobie transformaty sinusoidalne i pasmowo-przepustowe oraz model psychoakustyczny opisany w języku tych bloków. Wszystko, co można usunąć lub zredukować, jest usuwane i redukowane, a pozostała część jest wysyłana do strumienia wyjściowego. W rzeczywistości sprawa jest nieco bardziej skomplikowana, ponieważ bity muszą być rozłożone pomiędzy paskami. I oczywiście wszystko, co jest wysyłane, jest kodowane z redukcją redundancji.

Strumienie, częstotliwości i rozmiary ramek

Zarówno MPEG-1, jak i MPEG-2 można zastosować do szerokiej klasy strumieni, częstotliwości i rozmiarów ramek. MPEG-1, który jest znany większości ludzi, umożliwia prędkość 25 klatek na sekundę przy rozdzielczości 352x288 w systemie PAL lub 30 klatek na sekundę przy rozdzielczości 352x240 w systemie NTSC przy przepływności mniejszej niż 1,86 Mb/s – kombinacja znana jako „strumienie bitów o ograniczonych parametrach” Liczby te są wprowadzone w specyfikacji Białej Księgi dotyczącej wideo na CD (VideoCD).

W rzeczywistości składnia umożliwia kodowanie obrazów do rozdzielczości 4095 x 4095 z szybkością do 100 Mb/s. Liczby te mogłyby być nieskończone, gdyby nie ograniczenie liczby bitów w nagłówkach.

Wraz z pojawieniem się specyfikacji MPEG-2 najpopularniejsze kombinacje zostały połączone w warstwy i profile. Najczęstsze:

- Format wejścia źródłowego (SIF), 352 punkty x 240 linii x 30 kl./s, znany również jako niski poziom (LL) i

- „CCIR 601” (na przykład 720 punktów/linię x 480 linii x 30 kl./s) lub Poziom główny - poziom główny.

Kompensacja ruchu zastępuje makrobloki makroblokami z poprzednich zdjęć

Predykcje makrobloków są tworzone z odpowiednich bloków punktów 16x16 (16x8 w MPEG-2) z poprzednich zrekonstruowanych klatek. Nie ma ograniczeń co do położenia makrobloku na poprzednim obrazku, z wyjątkiem jego granic.

Ramki źródłowe – referencyjne – (z których tworzone są predykcje) są pokazane niezależnie od ich zakodowanej formy. Po zdekodowaniu ramka nie staje się zbiorem bloków, ale zwykłą płaską ramką obraz cyfrowy z punktów.

W formacie MPEG rozmiar wyświetlanego obrazu i liczba klatek na sekundę mogą różnić się od zakodowanych w strumieniu. Na przykład przed kodowaniem można pominąć podzbiór ramek w oryginalnej sekwencji, a następnie każda ramka jest filtrowana i przetwarzana. Po przywróceniu, interpolowana w celu przywrócenia oryginalny rozmiar i liczbę klatek na sekundę. W rzeczywistości trzy podstawowe fazy (częstotliwość pierwotna, zakodowana i wyświetlana) mogą różnić się parametrami. Składnia MPEG opisuje zakodowaną i wyświetlaną częstotliwość w nagłówkach, a oryginalna liczba klatek na sekundę i rozmiar są znane tylko koderowi. Dlatego nagłówki MPEG-2 zawierają elementy opisujące rozmiar ekranu do wyświetlania wideo.

W ramce I makrobloki muszą być zakodowane jako wewnętrzne - bez odniesienia do poprzednich lub kolejnych, chyba że stosowane są tryby skalowalne. Jednakże makrobloki w ramce P mogą być albo wewnętrzne, albo odnosić się do poprzednich ramek. Makrobloki w ramce B mogą być wewnętrzne lub odnosić się do poprzedniej klatki, następnej lub obu. Każdy nagłówek makrobloku posiada element określający jego typ.

Bez kompensacji ruchu:

Z kompensacją ruchu:

Pominięte makrobloki w ramkach P:

Pominięte makrobloki w ramkach B:

Sekwencja ramek może mieć dowolny układ ramek I, P i B. W praktyka przemysłowa Powszechnie stosuje się stałą sekwencję (np. IBBPBBPBBPBBPBB), jednakże mocniejsze kodery mogą zoptymalizować wybór typu klatki w zależności od kontekstu i globalnej charakterystyki sekwencji wideo.

Każdy typ ramki ma swoje zalety w zależności od charakterystyki obrazu (aktywność ruchowa, tymczasowe efekty maskowania,...).

Na przykład, jeśli sekwencja obrazów niewiele się zmienia z klatki na klatkę, sensowne jest zakodowanie większej liczby klatek B niż P. Ponieważ klatki B nie są używane w dalszy proces dekodowania, można je mocniej skompresować, bez wpływu na jakość wideo jako całości.

Wymagania konkretnej aplikacji wpływają również na wybór typu ramki: ramki kluczowe, przełączanie kanałów, indeksowanie programu, usuwanie błędów itp.

Podczas kompresji wideo wykorzystywane są następujące cechy statystyczne:

1. Korelacja przestrzenna: dyskretna transformata kosinusowa 8x8 punktów.

2. Funkcje ludzka wizja- odporność na składowe o wysokiej częstotliwości: skalarna kwantyzacja współczynników DCT z utratą jakości.

3. Duża korelacja przestrzenna obrazu całościowego: przewidywanie pierwszego współczynnika transformacji niskiej częstotliwości w bloku 8x8 (średnia z całego bloku).

4. Statystyka występowania elementów składniowych w najbardziej prawdopodobnym zakodowanym strumieniu: optymalne kodowanie wektorów ruchu, współczynniki DCT, rodzaje makrobloków itp.

5. Rzadka macierz skwantowanych współczynników DCT: kodowanie powtarzających się elementów zerowych wskazujących koniec bloku.

6. Maskowanie przestrzenne: stopień kwantyzacji makrobloku.

7. Kodowanie odcinków z uwzględnieniem treści sceny: stopień kwantyzacji makrobloku.

8. Dostosowanie do lokalnych charakterystyk obrazu: kodowanie blokowe, typ makrobloku, kwantyzacja adaptacyjna.

9. Stały rozmiar kroku z adaptacyjną kwantyzacją: ustawiany jest tylko nowy stopień kwantyzacji specjalny typ makrobloku i nie jest domyślnie przesyłany.

10. Redundancja czasowa: wektory ruchu do przodu i do tyłu na poziomie makrobloku 16x16 punktów.

11. Kodowanie błędów przewidywania makrobloków z uwzględnieniem percepcji: kwantyzacja adaptacyjna i kwantyzacja współczynnika transformacji.

12. Drobny błąd przewidywania: W przypadku makrobloku nie może być sygnalizowany żaden błąd.

13. Dokładne kodowanie błędu przewidywania na poziomie makrobloku: Każdy z bloków w makrobloku może zostać zakodowany lub pominięty.

14. Wektory ruchu - powolny ruch fragmentu obrazu złożony wzór: przewidywanie wektora ruchu.

15. Pojawienia się i zaginięcia: predykcja do przodu i do tyłu w ramkach B.

16. Dokładność przewidywania międzyramkowego: dwuliniowe interpolowane (filtrowane) różnice blokowe. W prawdziwy świat ruchy obiektów z klatki na klatkę rzadko mieszczą się w granicach punktów. Interpolacja pozwala ustalić rzeczywiste położenie obiektu, często zwiększając skuteczność kompresji o 1 dB.

17. Ograniczona aktywność ruchowa w ramkach P: pominięte makrobloki. Gdy wektor ruchu i błąd przewidywania wynoszą zero. Pominięte makrobloki są bardzo pożądane w zakodowanym strumieniu, ponieważ nie zajmują żadnych bitów z wyjątkiem nagłówka następnego makrobloku.

18. Ruch współpłaszczyznowy w klatkach B: pominięte makrobloki. Gdy wektor ruchu jest taki sam, a błąd przewidywania wynosi zero.

Ogłoszenie

Format pliku wideo MPEG

Różnica pomiędzy formatami MPEG i MPG jest bardzo mała. MPEG-więcej nowy format, który jest reprezentowany przez następujące podtypy: MPEG-1 - MPEG-4, MPEG-7 i MPEG-21. Kompresja stratna ułatwia pobieranie i przesyłanie plików, a także zmniejsza rozmiary plików przy zachowaniu wysokiej jakości. Te pliki kontenerów audio i wideo umożliwiają synchronizację obu strumieni danych. Wiele usług przesyłania strumieniowego online wykorzystuje pliki MPEG-1 do transmisji sygnałów audio, a także audio/wideo za pośrednictwem sieci kablowych i satelitarnych. System MPEG stał się podstawą do tworzenia plików MP3. Systemy operacyjne Mac i Windows obsługują pliki MPEG-1 i MPEG-2 przy użyciu różnych programów obsługujących takie formaty.

Informacje techniczne o plikach MPEG

Format MPEG-1 koduje wideo i powiązany dźwięk w celu późniejszego przechowywania z szybkością transmisji 1,5 Mb/s (ISO/IEC 11172) (format obsługuje wyższe przepływności). Umożliwia to kodowanie plików do formatów zbliżonych jakością do płyt CD lub DVD o niskiej jakości. Format MPEG-2 jest używany do transmisji telewizyjnych w wysokiej rozdzielczości. MPEG-3 jest używany jako skalowalny standard kompresji o wielu rozdzielczościach dla standardu HDTV (format ten został później połączony z MPEG-2 ze względu na prawie całkowity brak różnic z tym ostatnim). Format MPEG-4 pozwala na wyższy współczynnik kompresji (w porównaniu do MPEG-2), a także umożliwia osiągnięcie wyższej jakości kompresji przy zastosowaniu odpowiednich technik. Ostatecznie do wyświetlania wykorzystano ten standard Grafika komputerowa. Format MPEG-7 jest opisany w normie ISO-IEV 15938, a format MPEG-21 jest opisany w normie ISO/IEC 21000. Co więcej, takie standardy definiują ogólne zasady tworzenia danych medialnych, a także przewidują prawa autorskie.

Wstęp

Protoplastą tego formatu jest MPEG-1, o którym była mowa w poprzednim rozdziale bez wahania można nazwać prawdziwie rewolucyjnym, gdyż nic podobnego wcześniej nie istniało. Pierwsze płyty wideo i programy telewizji satelitarnej w formacie MPEG-1 wydawały się cudem – taka jakość przy tak stosunkowo niskim bitrate. Skompresowany cyfrowy obraz wideo miał jakość porównywalną z jakością domowego magnetowidu i miał wiele zalet w porównaniu z mediami analogowymi. Czas jednak mijał, postęp w dziedzinie technologii cyfrowej postępował skokowo i stary MPEG-1 wymagał znaczących ulepszeń, aby dotrzymać kroku cudom nauki i technologii. W rezultacie powstał format MPEG-2, który nie jest formatem rewolucyjnym, ale raczej ewolucyjnym, powstałym w wyniku przerobienia MPEG-1 na potrzeby klientów. A klientami tego formatu były największe koncerny masowego przekazu, które opierały się na telewizji satelitarnej i nieliniowym cyfrowym montażu wideo.Obecnie format MPEG-2 kojarzony jest przede wszystkim z płytami DVD, jednak w 1992 roku, kiedy rozpoczęły się prace nad stworzeniem tego formatu, nie było powszechnie dostępnego nośnika, na którym można by zapisać informację wideo skompresowaną do MPEG-2, ale co najważniejsze, technologia komputerowa tego formatu czas nie był w stanie zapewnić wymaganej przepustowości - od 2 do 9 Mbit na sekundę. Ale ten kanał mógłby zapewnić telewizję satelitarną z najnowocześniejszym wówczas sprzętem. Tak wysokie wymagania wobec kanału wcale nie oznaczały, że stopień kompresji MPEG-2 był niższy niż MPEG-1, wręcz przeciwnie, był znacznie wyższy! Jednak rozdzielczość obrazu i liczba klatek na sekundę są znacznie wyższe, ponieważ wysoka jakość przy rozsądnej przepływności była głównym celem, jaki klienci postawili przed komisją MPEG. To dzięki MPEG-2 możliwe stało się pojawienie się telewizji wysoka rozdzielczość- HDTV, w którym obraz jest znacznie wyraźniejszy niż w telewizji konwencjonalnej.

Kilka lat po rozpoczęciu prac, w październiku 1995 roku, za pośrednictwem satelity telewizji kosmicznej „Pan Am Sat” przeprowadzono pierwszą 20-kanałową transmisję telewizyjną w standardzie MPEG-2. Satelita prowadził i nadal nadaje w Skandynawii, Belgii, Holandii, Luksemburgu, na Bliskim Wschodzie i w Afryce.

Obecnie następuje szeroka ekspansja telewizji HDTV Daleki Wschód- w Japonii i Chinach.

Strumienie wideo skompresowane w formacie MPEG-2 o szybkości transmisji 9 Mbit na sekundę są wykorzystywane do nagrywania w studiu i wysokiej jakości cyfrowej edycji wideo.

Wraz z pojawieniem się pierwszych odtwarzaczy DVD, o ogromnej pojemności i stosunkowo przystępna cena, MPEG-2, który w sposób naturalny został wybrany jako główny format kompresji danych wideo ze względu na jego wysoką jakość i wysoki stopień kompresja. To właśnie filmy wykorzystujące MPEG-2 są w dalszym ciągu głównym argumentem przemawiającym za DVD.

Zakończmy retrospektywnym przeglądem MPEG-2 i spróbujmy zagłębić się w jego wewnętrzne elementy. Jak już wspomniano, MPEG-2 jest formatem ewolucyjnym, dlatego warto go rozważyć, porównując go ze słynnym przodkiem MPEG-1, wskazując, co nowego wprowadzono do formatu pierwotnego.

MPEG-2. Co nowego?

Trzeba powiedzieć, że twórcy MPEG-2 podeszli do rozwiązania problemu kreatywnie. Burzę mózgów wokół możliwości usunięcia dodatkowych bitów i bajtów z już skompresowanego obrazu (pamiętajcie, MPEG-1 już istniał, teraz trzeba było go skompresować) rozpoczęto z trzech stron jednocześnie. Stwierdzono, że oprócz ulepszenia algorytmów kompresji wideo (z jednej strony) i audio (z drugiej strony). alternatywna ścieżka zmniejszenie rozmiaru pliku końcowego, wcześniej nieużywanego.Jak wynika z badań komisji MPEG, ponad 95% danych wideo w taki czy inny sposób powtarza się w różnych klatkach więcej niż jeden raz. Dane te mają charakter balastowy lub, używając określenia zaproponowanego przez komisję MPEG, zbędne. Nadmiarowe dane są usuwane praktycznie bez uszkodzenia obrazu; powtarzające się sekcje są zastępowane podczas odtwarzania pojedynczym oryginalnym fragmentem. Do znanych już algorytmów kompresji i usuwania zbędne informacje, z którym spotkaliśmy się w formacie MPEG-1, dodano kolejny, najwyraźniej najskuteczniejszy. Po podzieleniu strumienia wideo na klatki algorytm ten analizuje zawartość kolejnej klatki pod kątem zduplikowanych, zbędnych danych. Trwa sporządzanie listy oryginalne działki oraz tabela powtarzających się sekcji. Oryginały są zachowywane, kopie usuwane, a tabela powtórzeń używana jest podczas dekodowania skompresowanego strumienia wideo. Efektem algorytmu usuwania nadmiarowych informacji jest obraz o doskonałej wysokiej rozdzielczości przy niskiej przepływności. Taki stosunek wielkości do jakości uznawano za nieosiągalny przed pojawieniem się MPEG-2.

Ale ten algorytm ma również ograniczenia. Przykładowo fragmenty powtarzające się muszą być odpowiednio duże, w przeciwnym razie konieczne byłoby utworzenie wpisu w tabeli sekcji powtarzalnych dla niemal każdego piksela, co zredukowałoby użyteczność tabeli do zera, gdyż jej rozmiar przekraczałby rozmiar rama. I ta okoliczność sprawia, że ten algorytm jest również mniej skuteczny - najbardziej przydatne i skuteczne byłoby zastosowanie tego algorytmu nie do pojedynczych klatek, ale do całego wideo jako całości, ponieważ prawdopodobieństwo znalezienia powtarzających się sekcji w dużej sekcji wideo jest znacznie wyższe niż w jednej klatce. Całkowity rozmiar tabel dla wszystkich ramek jest znacznie większy niż możliwy rozmiar jednej wspólnej tabeli. Niestety, MPEG-2 jest formatem przesyłania strumieniowego, który pierwotnie miał być przesyłany za pośrednictwem kanałów satelitarnych lub sieci kablowych, więc obecność klatek jest warunkiem wstępnym.

Przyjrzeliśmy się więc jednemu podejściu, które zapewniało znaczne zmniejszenie rozmiaru zakodowanego pliku, ale gdyby ta sztuczka była sama, programiści nigdy nie osiągnęliby tak imponujących wyników, jakie widzieliśmy w formacie MPEG-2. Oczywiście musieli ciężko pracować nad istniejącymi algorytmami, dosłownie je liżąc i wyciskając każdy ostatni bajt. Algorytmy kompresji wideo przeszły bardzo znaczącą modernizację.

Zmiany w algorytmach kompresji wideo w porównaniu do MPEG-1.

Główne zmiany dotyczyły algorytmów kwantyzacji, czyli algorytmów konwersji danych ciągłych na dyskretne. MPEG-2 wykorzystuje nieliniowy proces dyskretnej transformacji kosinusowej, który jest znacznie wydajniejszy niż jego poprzednik. Format MPEG-2 zapewnia użytkownikom i programistom znacznie większą swobodę w porównaniu do MPEG-1. Dzięki temu teraz podczas procesu kodowania możliwe stało się ustawienie dokładności współczynników częstotliwości macierzy kwantyzacji, co bezpośrednio wpływa na jakość obrazu uzyskanego w wyniku kompresji (i także na jego rozmiar). Korzystając z MPEG-2 użytkownik może ustawić następujące wartości precyzji kwantyzacji - 8, 9, 10 i 11 bitów na wartość elementu, co czyni ten format znacznie bardziej elastycznym w porównaniu do MPEG-1, który miał tylko jedną stałą wartość - 8 bitów na element.Możliwe jest także załadowanie osobnej macierzy kwantyzacji bezpośrednio przed każdą klatką, co pozwala na bardzo wysoka jakość obrazów, chociaż jest to dość pracochłonne. Jak mogę wykorzystać macierz kwantyzacji do poprawy jakości obrazu? Nie jest tajemnicą, że obszary szybko poruszające się są tradycyjnie słabość dla rodziny MPEG, podczas gdy statyczne części obrazu są kodowane bardzo dobrze. Prowadzi to do wniosku, że nie da się w ten sam sposób zakodować obszarów statycznych i obszarów z ruchem. Ponieważ jakość obrazu zależy od etapu kwantyzacji, który w dużej mierze zależy od zastosowanej matrycy kwantyzacji, zmiana tych macierzy dla różnych fragmentów wideo może poprawić jakość obrazu. Wiele kodeków MPEG-2 robi to automatycznie, ale są programy, które pozwalają również na ręczne ustawienie macierzy kwantyzacji, np. transkoder AVI2MPG2, który można znaleźć w Internecie pod adresem: http://members.home.net/beyeler/ bbmpeg.html. Jeśli link nie działa, skorzystaj z naszej kopii pliku: bbmpg123.zip

Algorytmy przewidywania ruchu nie szczędziły innowacji. Sekcja ta została wzbogacona o nowe tryby: 16x8 MC, Field MC oraz Dual Prime. Algorytmy te znacznie poprawiły jakość obrazu i, co ważne, umożliwiły rzadsze wykonywanie klatek kluczowych w porównaniu do MPEG-1, zwiększając tym samym liczbę klatek pośrednich i zwiększając stopień kompresji. Główny rozmiar bloków, na które podzielony jest obraz, może wynosić 8x8 pikseli, np. MPEG-1, 16x16 i 16x8, który jednak jest używany tylko w trybie 16x8 MS.

Ze względu na pewne cechy implementacji algorytmów przewidywania ruchu w formacie MPEG-2 istnieją pewne ograniczenia dotyczące rozmiaru obrazu. Obecnie konieczne stało się, aby rozdzielczość pionowa i pozioma obrazu była wielokrotnością 16 w trybie kodowania klatka po klatce i 32 w pionie w trybie kodowania polowego, gdzie każde pole składa się z dwóch klatek. Rozmiar ramki wzrósł do 16383*16383.

Wprowadzono jeszcze dwa stosunki płaszczyzn barw i płaszczyzn natężenia oświetlenia – 4:4:4 i 4:2:2.

Oprócz powyższych ulepszeń, do formatu MPEG-2 wprowadzono kilka nowych algorytmów kompresji wideo, które nigdy wcześniej nie były używane.

Najważniejsze z nich to algorytmy zwane trybami skalowalnymi, skalowalnością przestrzenną, partycjonowaniem danych, skalowalnością stosunku sygnału do szumu (SNR) i skalowalnością czasową. Nie ma wątpliwości, że algorytmy te w bardzo istotny sposób przyczyniły się do sukcesu MPEG-2 i zasługują na dalsze rozważenie.

Skalowalne tryby- zestaw algorytmów pozwalający określić poziom priorytetów poszczególnych warstw strumienia wideo. Strumień danych wideo jest podzielony na trzy warstwy – podstawową, średnią i wysoką. Najwyższy priorytet włączony ten moment warstwa (na przykład pierwszy plan) jest kodowana z większą szybkością transmisji

Skalowalność przestrzenna(skalowanie przestrzenne) - przy zastosowaniu tego algorytmu warstwa bazowa jest kodowana z niższą rozdzielczością. Następnie informacje uzyskane w wyniku kodowania wykorzystywane są w algorytmach przewidywania ruchu warstw o wyższym priorytecie.

Partycjonowanie danych(fragmentacja danych) - algorytm ten dzieli bloki 64 elementów macierzy kwantyzacji na dwa strumienie. Jeden strumień danych, o wyższym priorytecie, składa się ze składników o niskiej częstotliwości (najbardziej krytycznych dla jakości), drugi, o odpowiednio niższym priorytecie, składa się ze składników o wysokiej częstotliwości. Strumienie te są następnie przetwarzane w różny sposób. Dlatego w formacie MPEG-2 zarówno sceny dynamiczne, jak i statystyczne wyglądają całkiem nieźle, w przeciwieństwie do MPEG-1, gdzie sceny dynamiczne są tradycyjnie okropne.

Stosunek sygnału do szumu(SNR) Skalowalność (skalowanie stosunku sygnału do szumu) - gdy ten algorytm działa, kodowane są warstwy o różnym priorytecie inna jakość. Warstwy o niskim priorytecie są próbkowane częściej i zawierają mniej danych, podczas gdy warstwa o wysokim priorytecie zawiera Dodatkowe informacje, który po zdekodowaniu pozwala przywrócić obraz wysokiej jakości.

Skalowalność czasowa(skalowanie czasowe) - po działaniu tego algorytmu zmniejsza się liczba kluczowych bloków informacji w warstwie o niskim priorytecie, natomiast warstwa o wysokim priorytecie przeciwnie, zawiera dodatkowe informacje, które pozwalają przywrócić ramki pośrednie za pomocą informacje z warstwy o niższym priorytecie na potrzeby predykcji

Wszystkie te algorytmy mają ze sobą wiele wspólnego: wszystkie pracują z warstwami strumienia danych wideo, zastosowanie tych algorytmów pozwala na osiągnięcie wysokiej kompresji przy niemal niezauważalnej degradacji obrazu. Ale jest jeszcze jedna właściwość tych algorytmów, być może niezbyt przyjemna. Użycie któregokolwiek z nich powoduje, że wideo jest całkowicie niezgodne z formatem MPEG-1. Dlatego te algorytmy nie były dostępne w każdym kodeku MPEG-2.

W rezultacie pojawiło się wiele formatów, o różnych rozdzielczościach, jakości, o różnym stopniu kompresji i różnych proporcjach wielkości do jakości. W celu przywrócenia porządku i ostatecznej standaryzacji MPEG-2 Komitet MPEG wprowadził koncepcje poziomów i profili. To właśnie poziomy i profile oraz ich kombinacje pozwalają jednoznacznie opisać niemal każdy format z rodziny MPEG-2.

Poziomy

| nazwa poziomu | pozwolenie | maksymalny bitrate | zgodność jakościowa |

| Niski | 352*240*30 | 4 Mb/s | CIF, konsumencka kaseta wideo |

| Główny | 720*480*30 | 15 Mb/s | CCIR 601, telewizor studyjny |

| Wysoka 1440 | 1440*1152*30 | 60 Mb/s | 4x601, domowy telewizor HD |

| Wysoki | 1920*1080*30 | 80 Mb/s | Wysokiej klasy sprzęt do edycji wideo |

Profile

Prawidłowe kombinacje profili i poziomów

| Prosty | Główny | Główny+ | Następny |

| Wysoki | NIE | NIE | 4:2:2 |

| Wysoka 1440 | NIE | Główny ze skalowalnością przestrzenną | 4:2:2 |

| Główny | 90% wszystkich | Główny ze skalowalnością SNR | 4:2:2 |

| Niski | NIE | Główny ze skalowalnością SNR | NIE |

Najpopularniejsze standardy.

| Nazwa | Pozwolenie |

Charakterystyka formatów, porównanie, historia powstania i rozwoju.

Wstęp

Protoplastę tego formatu, MPEG-1, można bez wahania nazwać prawdziwie rewolucyjnym, gdyż nic podobnego wcześniej nie istniało. Pierwsze płyty wideo i programy telewizji satelitarnej w formacie MPEG-1 wydawały się cudem – taka jakość przy tak stosunkowo niskim bitrate. Skompresowany cyfrowy obraz wideo miał jakość porównywalną z jakością domowego magnetowidu i miał wiele zalet w porównaniu z mediami analogowymi. Ale czas mijał, postęp w tej dziedzinie technologie cyfrowe poruszał się błyskawicznie, a teraz stary MPEG-1 potrzebował znaczących ulepszeń, aby dotrzymać kroku cudom nauki i technologii. W rezultacie powstał format MPEG-2, który nie jest formatem rewolucyjnym, ale raczej ewolucyjnym, powstałym w wyniku przerobienia MPEG-1 na potrzeby klientów. A klientami tego formatu były największe koncerny masowego przekazu, które opierały się na telewizji satelitarnej i nieliniowym cyfrowym montażu wideo.

Obecnie format MPEG-2 kojarzony jest przede wszystkim z płytami DVD, jednak w 1992 roku, kiedy rozpoczęły się prace nad stworzeniem tego formatu, nie było powszechnie dostępnego nośnika, na którym można by zapisać informację wideo skompresowaną do MPEG-2, ale co najważniejsze, technologia komputerowa tego formatu czas nie był w stanie zapewnić wymaganej przepustowości - od 2 do 9 Mbit na sekundę. Ale ten kanał mógłby zapewnić telewizję satelitarną z najnowocześniejszym wówczas sprzętem. Tak wysokie wymagania wobec kanału wcale nie oznaczały, że stopień kompresji MPEG-2 był niższy niż MPEG-1, wręcz przeciwnie, był znacznie wyższy! Jednak rozdzielczość obrazu i liczba klatek na sekundę są znacznie wyższe, ponieważ wysoka jakość przy rozsądnej przepływności była głównym celem, jaki klienci postawili przed komisją MPEG. To właśnie dzięki MPEG-2 możliwe stało się pojawienie się telewizji wysokiej rozdzielczości – HDTV, w której obraz jest znacznie wyraźniejszy niż w telewizji konwencjonalnej.

Kilka lat po rozpoczęciu prac, w październiku 1995 roku, za pośrednictwem satelity telewizji kosmicznej „Pan Am Sat” przeprowadzono pierwszą 20-kanałową transmisję telewizyjną w standardzie MPEG-2. Satelita prowadził i nadal nadaje w Skandynawii, Belgii, Holandii, Luksemburgu, na Bliskim Wschodzie i w Afryce.

Obecnie ma miejsce szeroka ekspansja HDTV na Dalekim Wschodzie – w Japonii i Chinach.

Strumienie wideo skompresowane w formacie MPEG-2 o szybkości transmisji 9 Mbit na sekundę są wykorzystywane do nagrywania w studiu i wysokiej jakości cyfrowej edycji wideo.

Wraz z pojawieniem się pierwszych odtwarzaczy DVD, które miały ogromną pojemność i stosunkowo przystępną cenę, MPEG-2 został w sposób naturalny wybrany jako główny format kompresji danych wideo ze względu na wysoką jakość i wysoki współczynnik kompresji. To właśnie filmy wykorzystujące MPEG-2 są w dalszym ciągu głównym argumentem przemawiającym za DVD.

Zakończmy retrospektywnym przeglądem MPEG-2 i spróbujmy zagłębić się w jego wewnętrzne elementy. Jak już wspomniano, MPEG-2 jest formatem ewolucyjnym, dlatego warto go rozważyć, porównując go ze słynnym przodkiem MPEG-1, wskazując, co nowego wprowadzono do formatu pierwotnego.

MPEG-2. Co nowego?

Trzeba powiedzieć, że twórcy MPEG-2 podeszli do rozwiązania problemu kreatywnie. Burzę mózgów wokół możliwości usunięcia dodatkowych bitów i bajtów z już skompresowanego obrazu (pamiętajcie, MPEG-1 już istniał, teraz trzeba było go skompresować) rozpoczęto z trzech stron jednocześnie. Oprócz ulepszenia algorytmów kompresji wideo (z jednej strony) i audio (z drugiej strony), znaleziono alternatywny sposób zmniejszenia rozmiaru pliku końcowego, który nie był wcześniej używany.

Jak wynika z badań komisji MPEG, ponad 95% danych wideo w taki czy inny sposób powtarza się w różnych klatkach więcej niż jeden raz. Dane te mają charakter balastowy lub, używając określenia zaproponowanego przez komisję MPEG, zbędne. Nadmiarowe dane są usuwane praktycznie bez uszkodzenia obrazu; powtarzające się sekcje są zastępowane podczas odtwarzania pojedynczym oryginalnym fragmentem. Do znanych już algorytmów kompresji i usuwania zbędnych informacji, które napotkaliśmy w formacie MPEG-1, dodano kolejny, najwyraźniej najskuteczniejszy. Po podzieleniu strumienia wideo na klatki algorytm ten analizuje zawartość kolejnej klatki pod kątem powtarzających się, zbędnych danych.

Sporządzono listę sekcji oryginalnych i tabelę sekcji powtarzalnych. Oryginały są zachowywane, kopie usuwane, a tabela powtórzeń używana jest podczas dekodowania skompresowanego strumienia wideo. Wynikiem algorytmu usuwania nadmiarowych informacji jest obraz o doskonałej wysokiej rozdzielczości przy niskiej przepływności. Taki stosunek wielkości do jakości uznawano za nieosiągalny przed pojawieniem się MPEG-2.

Ale ten algorytm ma również ograniczenia. Przykładowo fragmenty powtarzające się muszą być odpowiednio duże, w przeciwnym razie konieczne byłoby utworzenie wpisu w tabeli sekcji powtarzalnych dla niemal każdego piksela, co zredukowałoby użyteczność tabeli do zera, gdyż jej rozmiar przekraczałby rozmiar rama. I ta okoliczność sprawia również, że ten algorytm jest mniej skuteczny - najbardziej przydatne i skuteczne byłoby zastosowanie tego algorytmu nie do pojedynczych klatek, ale do całego wideo jako całości, ponieważ prawdopodobieństwo znalezienia powtarzających się sekcji w dużej sekcji wideo jest znacznie wyższe niż w jednej klatce. Całkowity rozmiar tabel dla wszystkich ramek jest znacznie większy niż możliwy rozmiar jednej wspólnej tabeli. Niestety, MPEG-2 jest formatem przesyłania strumieniowego, który pierwotnie miał być przesyłany kanały satelitarne lub za pośrednictwem sieci kablowych, dlatego obecność ramek jest warunkiem wstępnym.

Przyjrzeliśmy się więc jednemu podejściu, które zapewniało znaczne zmniejszenie rozmiaru zakodowanego pliku, ale gdyby ta sztuczka była sama, programiści nigdy nie osiągnęliby tak imponujących wyników, jakie widzieliśmy w formacie MPEG-2. Oczywiście musieli ciężko pracować nad istniejącymi algorytmami, dosłownie je liżąc i wyciskając każdy ostatni bajt. Algorytmy kompresji wideo przeszły bardzo znaczącą modernizację.

Zmiany w algorytmach kompresji wideo w porównaniu do MPEG-1.

Główne zmiany dotyczyły algorytmów kwantyzacji, czyli algorytmów konwersji danych ciągłych na dyskretne. MPEG-2 wykorzystuje nieliniowy proces dyskretnej transformacji kosinusowej, który jest znacznie wydajniejszy niż jego poprzednik. Format MPEG-2 zapewnia użytkownikom i programistom znacznie większą swobodę w porównaniu do MPEG-1. Dzięki temu teraz podczas procesu kodowania możliwe stało się ustawienie dokładności współczynników częstotliwości macierzy kwantyzacji, co bezpośrednio wpływa na jakość obrazu uzyskanego w wyniku kompresji (i także na jego rozmiar). Korzystając z MPEG-2 użytkownik może ustawić następujące wartości precyzji kwantyzacji - 8, 9, 10 i 11 bitów na wartość elementu, co czyni ten format znacznie bardziej elastycznym w porównaniu do MPEG-1, który miał tylko jedną stałą wartość - 8 bitów na element.

Możliwe jest także załadowanie osobnej matrycy kwantyzacji bezpośrednio przed każdą klatką, co pozwala na uzyskanie bardzo wysokiej jakości obrazu, choć jest to dość pracochłonne. Jak mogę wykorzystać macierz kwantyzacji do poprawy jakości obrazu? Nie jest tajemnicą, że szybko poruszające się obszary są tradycyjnie słabym punktem rodziny MPEG, podczas gdy statyczne obszary obrazu są kodowane bardzo dobrze. Prowadzi to do wniosku, że nie da się w ten sam sposób zakodować obszarów statycznych i obszarów z ruchem. Ponieważ jakość obrazu zależy od etapu kwantyzacji, który w dużej mierze zależy od zastosowanej matrycy kwantyzacji, zmiana tych macierzy dla różnych fragmentów wideo może poprawić jakość obrazu. Wiele kodeków MPEG-2 robi to automatycznie, ale są programy, które pozwalają również na ręczne ustawienie macierzy kwantyzacji, np. transkoder AVI2MPG2, który można znaleźć w Internecie pod adresem: http://members.home.net/beyeler/ bbmpeg.html.

Algorytmy przewidywania ruchu nie szczędziły innowacji. Sekcja ta została wzbogacona o nowe tryby: 16x8 MC, Field MC oraz Dual Prime. Algorytmy te znacznie poprawiły jakość obrazu i, co ważne, umożliwiły rzadsze wykonywanie klatek kluczowych w porównaniu do MPEG-1, zwiększając tym samym liczbę klatek pośrednich i zwiększając stopień kompresji. Główny rozmiar bloków, na które podzielony jest obraz, może wynosić 8x8 pikseli, np. MPEG-1, 16x16 i 16x8, który jednak jest używany tylko w trybie 16x8 MS.

Ze względu na pewne cechy implementacji algorytmów przewidywania ruchu w formacie MPEG-2 istnieją pewne ograniczenia dotyczące rozmiaru obrazu. Obecnie konieczne stało się, aby rozdzielczość pionowa i pozioma obrazu była wielokrotnością 16 w trybie kodowania klatka po klatce i 32 w pionie w trybie kodowania polowego, gdzie każde pole składa się z dwóch klatek. Rozmiar ramki wzrósł do 16383*16383.

Wprowadzono jeszcze dwa stosunki płaszczyzn barw i płaszczyzn natężenia oświetlenia – 4:4:4 i 4:2:2.

Oprócz powyższych ulepszeń, do formatu MPEG-2 wprowadzono kilka nowych algorytmów kompresji wideo, które nigdy wcześniej nie były używane.

Najważniejsze z nich to algorytmy zwane trybami skalowalnymi, skalowalnością przestrzenną, partycjonowaniem danych, skalowalnością stosunku sygnału do szumu (SNR) i skalowalnością czasową. Nie ma wątpliwości, że algorytmy te w bardzo istotny sposób przyczyniły się do sukcesu MPEG-2 i zasługują na dalsze rozważenie.

Skalowalne tryby- zestaw algorytmów pozwalający określić poziom priorytetów poszczególnych warstw strumienia wideo. Strumień danych wideo jest podzielony na trzy warstwy – podstawową, średnią i wysoką. Warstwa o najwyższym priorytecie (na przykład pierwszy plan) jest kodowana z większą szybkością transmisji

Skalowalność przestrzenna(skalowanie przestrzenne) - przy zastosowaniu tego algorytmu warstwa bazowa jest kodowana z niższą rozdzielczością. Następnie informacje uzyskane w wyniku kodowania wykorzystywane są w algorytmach przewidywania ruchu warstw o wyższym priorytecie.

Partycjonowanie danych(fragmentacja danych) - algorytm ten dzieli bloki 64 elementów macierzy kwantyzacji na dwa strumienie. Jeden strumień danych, o wyższym priorytecie, składa się ze składników o niskiej częstotliwości (najbardziej krytycznych dla jakości), drugi, o odpowiednio niższym priorytecie, składa się ze składników o wysokiej częstotliwości. Strumienie te są następnie przetwarzane w różny sposób. Dlatego w formacie MPEG-2 zarówno sceny dynamiczne, jak i statystyczne wyglądają całkiem nieźle, w przeciwieństwie do MPEG-1, gdzie sceny dynamiczne są tradycyjnie okropne.

Stosunek sygnału do szumu(SNR) Skalowalność (skalowanie stosunku sygnału do szumu) - dzięki temu algorytmowi warstwy o różnym priorytecie są kodowane z różną jakością. Warstwy o niskim priorytecie są próbkowane częściej, są grubsze i dlatego zawierają mniej danych, a warstwa o wysokim priorytecie zawiera dodatkowe informacje, które po zdekodowaniu pozwalają przywrócić obraz o wysokiej jakości.

Skalowalność czasowa(skalowanie czasowe) - po działaniu tego algorytmu zmniejsza się liczba kluczowych bloków informacji w warstwie o niskim priorytecie, natomiast warstwa o wysokim priorytecie przeciwnie, zawiera dodatkowe informacje, które pozwalają przywrócić ramki pośrednie za pomocą informacje z warstwy o niższym priorytecie na potrzeby predykcji.

Wszystkie te algorytmy mają ze sobą wiele wspólnego: wszystkie pracują z warstwami strumienia danych wideo, zastosowanie tych algorytmów pozwala na osiągnięcie wysokiej kompresji przy niemal niezauważalnej degradacji obrazu. Ale jest jeszcze jedna właściwość tych algorytmów, być może niezbyt przyjemna. Użycie któregokolwiek z nich powoduje, że wideo jest całkowicie niezgodne z formatem MPEG-1. Dlatego te algorytmy nie były dostępne w każdym kodeku MPEG-2.

W rezultacie pojawiło się wiele formatów, o różnych rozdzielczościach, jakości, o różnym stopniu kompresji i różnych proporcjach wielkości do jakości. W celu przywrócenia porządku i ostatecznej standaryzacji MPEG-2 Komitet MPEG wprowadził koncepcje poziomów i profili. To właśnie poziomy i profile oraz ich kombinacje pozwalają jednoznacznie opisać niemal każdy format z rodziny MPEG-2.

Poziomy

|

Nazwa poziomu |

pozwolenie |

maksymalny bitrate |

zgodność jakościowa |

|

CIF, konsumencka kaseta wideo |

|||

|

CCIR 601, telewizor studyjny |

|||

|

4x601, domowy telewizor HD |

|||

|

Wysokiej klasy sprzęt do edycji wideo |

Profile

Prawidłowe kombinacje profili i poziomów

|

Główny ze skalowalnością przestrzenną |

|||

|

90% wszystkich |

Główny ze skalowalnością SNR |

||

|

Główny ze skalowalnością SNR |

Najpopularniejsze standardy

|

Nazwa |

Pozwolenie |