Что такое энтропия? Энтропия – что это такое: объяснение термина простыми словами

Введение 4

Понятие энтропии 5

Измерение энтропии 8

Понятия и примеры возрастания энтропии 9

Заключение 13

Список литературы 14

Введение

Естествознание – это раздел науки основанный на воспроизводимой эмпирической проверке гипотез и создании теорий или эмпирических обобщений, описывающих природные явления.

Предмет естествознания - факты и явления, воспринимаемые нашими органами чувств. Задача ученого обобщить эти факты и создать теоретическую модель изучаемого явления природы включающую законы управляющие им. Явления, например, закон всемирного тяготения, даются нам в опыте; один из законов науки - закон всемирного тяготения, представляет собой варианты объяснения этих явлений. Факты, будучи установлены, сохраняют свою актуальность всегда, законы могут быть пересмотрены или скорректированы в соответствии с новыми данными или новой концепцией их объясняющей. Факты действительности являются необходимой составляющей научного исследования.

Основной принцип естествознания гласит 1: знания о природе должны допускать эмпирическую проверку. Это не означает, что научная теория должна немедленно подтверждаться, но каждое ее положение должно быть таким, чтобы такая проверка была возможна в принципе.

От технических наук естествознание отличает то, что оно преимущественно направлено не на преобразование мира, а на его познание. От математики естествознание отличает то, что оно исследует природные, а не знаковые системы. Попробовать связать естествознание, технические и математическую науки попробуем с помощью понятия – «энтропия».

Таким образом, целью данной работы является рассмотрение и решение следующих задач:

Понятие энтропии;

Измерение энтропии;

Понятия и примеры возрастания энтропии.

Понятие энтропии

Понятие энтропии было введено Р. Клаузиусом 2 , сформулировавшим второе начало термодинамики, согласно которому переход теплоты от более холодного тела к более теплому не может происходить без затраты внешней работы.

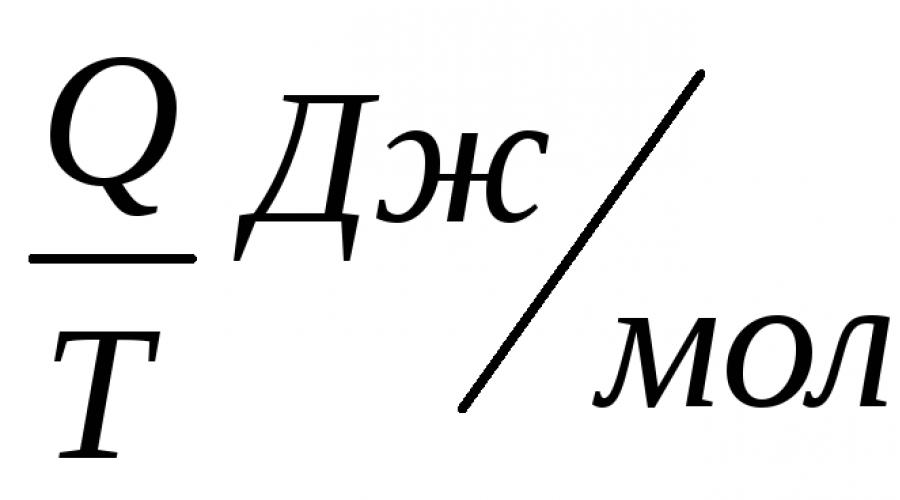

Он определил изменение энтропии термодинамической системы при обратимом процессе как отношение изменения общего количества тепла ΔQ к величине абсолютной температуры T:

Рудольф Клаузиус дал величине S имя «энтропия», происходящее от греческого слова τρoπή, «изменение» (изменение, превращение, преобразование).

Эта формула применима только для изотермического процесса (происходящего при постоянной температуре). Её обобщение на случай произвольного квазистатического процесса выглядит так:

где dS - приращение (дифференциал) энтропии, а δQ - бесконечно малое приращение количества теплоты.

Заметим, что энтропия является функцией состояния, поэтому в левой части равенства стоит её полный дифференциал. Напротив, количество теплоты являетсяфункцией процесса, в котором эта теплота была передана, поэтому δQ ни в коем случае нельзя считать полным дифференциалом.

Энтропия, таким образом, определена вплоть до произвольной аддитивной постоянной. Третье начало термодинамикипозволяет определить её точно: при этом энтропию равновесной системы при абсолютном нуле температуры считают равной нулю.

Энтропия – это количественная мера той теплоты, которая не переходит в работу.

S 2

-S 1

=ΔS=

Или, другими словами, энтропия – мера рассеивания свободной энергии. А ведь нам уже известно, что любая открытая термодинамическая система в стационарном состоянии стремится к минимальному рассеиванию свободной энергии. Поэтому если в силу причин система отклонилась от стационарного состояния, то вследствие стремления системы к минимальной энтропии, в ней возникают внутренние изменения, возвращающие ее в стационарное состояние.

Как видно из выше написанного, энтропия характеризует определенную направленность процесса в замкнутой системе. В соответствии со вторым началом термодинамики 3 возрастанию энтропии соответствует направление теплового потока от более горячего тела к менее горячему. Непрерывное возрастание энтропии в замкнутой системе происходит до тех пор, пока температура не выровняется по всему объему системы. Наступает, как говорят, термодинамическое равновесие системы, при котором исчезают направленные тепловые потоки и система становится однородной.

Абсолютное значение энтропии зависит от целого ряда физических параметров. При фиксированном объеме энтропия увеличивается с увеличением температуры системы, а при фиксированной температуре увеличивается с увеличением объема и уменьшением давления. Нагревание системы сопровождается фазовыми превращениями и снижением степени упорядоченности системы, поскольку твердое тело переходит в жидкость, а жидкость превращается в газ. При охлаждении вещества происходит обратный процесс, упорядоченность системы возрастает. Эта упорядоченность проявляется в том, что молекулы вещества занимают все более определенное положение относительно друг друга. В твердом теле их положение фиксировано структурой кристаллической решетки.

Другими словами - энтропия выступает мерой хаоса 4 (споры определения которого ведутся уже давно).

Все процессы в природе протекают в направлении увеличения энтропии. Термодинамическому равновесию системы соответствует состояние с максимумом энтропии. Равновесие, которому соответствует максимум энтропии, называется абсолютно устойчивым. Таким образом, увеличение энтропии системы означает переход в состояние, имеющее большую вероятность. То есть энтропия характеризует вероятность, с которой устанавливается то или иное состояние, и является мерой хаотичности или необратимости. Это мера хаоса в расположении атомов, фотонов, электронов и других частиц. Чем больше порядка, тем меньше энтропия. Чем больше информации поступает в систему, тем система более организована, и тем меньше её энтропия:

(По теории Шеннона 5)

Энтропия (от др.-греч. ἐντροπία «поворот», «превращение») – широко используемый в естественных и точных науках термин. Впервые введён в рамках термодинамики как функция состояния термодинамической системы, определяющая меру необратимого рассеивания энергии. В статистической физике энтропия характеризует вероятность осуществления какого-либо макроскопического состояния. Кроме физики, термин широко употребляется в математике: теории информации и математической статистике.

В науку это понятие вошло ещё в XIX веке. Изначально оно было применимо к теории тепловых машин, но достаточно быстро появилось и в остальных областях физики, особенно, в теории излучения. Очень скоро энтропия стала применяться в космологии, биологии, в теории информации. Различные области знаний выделяют разные виды меры хаоса:

- информационная;

- термодинамическая;

- дифференциальная;

- культурная и др.

Например, для молекулярных систем существует энтропия Больцмана, определяющая меру их хаотичности и однородности. Больцман сумел установить взаимосвязь между мерой хаоса и вероятностью состояния. Для термодинамики данное понятие считается мерой необратимого рассеяния энергии. Это функция состояния термодинамической системы. В обособленной системе энтропия растёт до максимальных значений, и они в итоге становятся состоянием равновесия. Энтропия информационная подразумевает некоторую меру неопределённости или непредсказуемости.

Энтропия может интерпретироваться как мера неопределённости (неупорядоченности) некоторой системы, например, какого-либо опыта (испытания), который может иметь разные исходы, а значит, и количество информации. Таким образом, другой интерпретацией энтропии является информационная ёмкость системы. С данной интерпретацией связан тот факт, что создатель понятия энтропии в теории информации (Клод Шеннон) сначала хотел назвать эту величину информацией.

Для обратимых (равновесных) процессов выполняется следующее математическое равенство (следствие так называемого равенства Клаузиуса), где – подведенная теплота, – температура, и – состояния, и – энтропия, соответствующая этим состояниям (здесь рассматривается процесс перехода из состояния в состояние).

Для необратимых процессов выполняется неравенство, вытекающее из так называемого неравенства Клаузиуса, где – подведенная теплота, – температура, и – состояния, и – энтропия, соответствующая этим состояниям.

Поэтому энтропия адиабатически изолированной (нет подвода или отвода тепла) системы при необратимых процессах может только возрастать.

Используя понятие энтропии Клаузиус (1876) дал наиболее общую формулировку 2-го начала термодинамики: при реальных (необратимых) адиабатических процессах энтропия возрастает, достигая максимального значения в состоянии равновесия (2-ое начало термодинамики не является абсолютным, оно нарушается при флуктуациях).

Абсолютная энтропия (S) вещества или процесса – это изменение доступной энергии при теплопередаче при данной температуре (Btu/R, Дж/К). Математически энтропия равняется теплопередаче, деленной на абсолютную температуру, при которой происходит процесс. Следовательно, процессы передачи большого количества теплоты больше увеличивают энтропию. Также изменения энтропии увеличатся при передаче теплоты при низкой температуре. Так как абсолютная энтропия касается пригодности всей энергии вселенной, температуру обычно измеряют в абсолютных единицах (R, К).

Удельную энтропию (S) измеряют относительно единицы массы вещества. Температурные единицы, которые используются при вычислении разниц энтропии состояний, часто приводятся с температурными единицами в градусах по Фаренгейту или Цельсию. Так как различия в градусах между шкалами Фаренгейта и Ренкина или Цельсия и Кельвина равные, решение в таких уравнениях будет правильным независимо от того, выражена энтропия в абсолютных или обычных единицах. У энтропии такая же данная температура, как и данная энтальпия определенного вещества.

Подводим итог: энтропия увеличивается, следовательно, любыми своими действиями мы увеличиваем хаос.

Просто о сложном

Энтропия – мера беспорядка (и характеристика состояния). Визуально, чем более равномерно расположены вещи в некотором пространстве, тем больше энтропия. Если сахар лежит в стакане чая в виде кусочка, энтропия этого состояния мала, если растворился и распределился по всем объёму – велика. Беспорядок можно измерить, например, посчитав сколькими способами можно разложить предметы в заданном пространстве (энтропия тогда пропорциональна логарифму числа раскладок). Если все носки сложены предельно компактно одной стопкой на полке в шкафу, число вариантов раскладки мало и сводится только к числу перестановок носков в стопке. Если носки могут находиться в произвольном месте в комнате, то существует немыслимое число способов разложить их, и эти раскладки не повторяются в течение нашей жизни, как и формы снежинок. Энтропия состояния «носки разбросаны» – огромна.

Второй закон термодинамики гласит, что самопроизвольно в замкнутой системе энтропия не может убывать (обычно она возрастает). Под её влиянием рассеивается дым, растворяется сахар, рассыпаются со временем камни и носки. Эта тенденция объясняется просто: вещи движутся (перемещаются нами или силами природы) обычно под влиянием случайных импульсов, не имеющих общей цели. Если импульсы случайны, всё будет двигаться от порядка к беспорядку, потому что способов достижения беспорядка всегда больше. Представьте себе шахматную доску: король может выйти из угла тремя способами, все возможные для него пути ведут из угла, а прийти обратно в угол с каждой соседней клетки – только одним способом, причём этот ход будет только одним из 5 или из 8 возможных ходов. Если лишить его цели и позволить двигаться случайно, он в конце концов с равной вероятностью сможет оказаться в любом месте шахматной доски, энтропия станет выше.

В газе или жидкости роль такой разупорядочивающей силы играет тепловое движение, в вашей комнате – ваши сиюминутные желания пойти туда, сюда, поваляться, поработать, итд. Каковы эти желания – неважно, главное, что они не связаны с уборкой и не связаны друг с другом. Чтобы снизить энтропию, нужно подвергнуть систему внешнему воздействию и совершить над ней работу. Например, согласно второму закону, энтропия в комнате будет непрерывно возрастать, пока не зайдёт мама и не попросит вас слегка прибрать. Необходимость совершить работу означает также, что любая система будет сопротивляться уменьшению энтропии и наведению порядка. Во Вселенной та же история – энтропия как начала возрастать с Большого Взрыва, так и будет расти, пока не придёт Мама.

Мера хаоса во Вселенной

Для Вселенной не может быть применён классический вариант вычисления энтропии, потому что в ней активны гравитационные силы, а вещество само по себе не может образовать замкнутую систему. Фактически, для Вселенной – это мера хаоса.

Главнейшим и крупнейшим источником неупорядоченности, которая наблюдается в нашем мире, считаются всем известные массивные образования – чёрные дыры, массивные и сверхмассивные.

Попытки точно рассчитать значение меры хаоса пока нельзя назвать удачными, хотя они происходят постоянно. Но все оценки энтропии Вселенной имеют значительный разброс в полученных значениях – от одного до трёх порядков. Это объясняется не только недостатком знаний. Ощущается недостаточность сведений о влиянии на расчёты не только всех известных небесных объектов, но и тёмной энергии. Изучение её свойств и особенностей пока в зачатке, а влияние может быть определяющим. Мера хаоса Вселенной всё время изменяется. Учёные постоянно проводят определённые исследования, чтобы получить возможность определения общих закономерностей. Тогда будет можно делать достаточно верные прогнозы существования различных космических объектов.

Тепловая смерть Вселенной

У любой замкнутой термодинамической системы есть конечное состояние. Вселенная тоже не является исключением. Когда прекратится направленный обмен всех видов энергий, они переродятся в тепловую энергию. Система перейдёт в состояние тепловой смерти, если термодинамическая энтропия получит наивысшие значение. Вывод о таком конце нашего мира сформулировал Р. Клаузиус в 1865 году. Он взял за основу второй закон термодинамики. Согласно этому закону, система, которая не обменивается энергиями с другими системами, будет искать равновесное состояние. А оно вполне может иметь параметры, характерные для тепловой смерти Вселенной. Но Клаузиус не учитывал влияния гравитации. То есть, для Вселенной, в отличие от системы идеального газа, где частицы распределены в каком-то объёме равномерно, однородность частиц не может соответствовать самому большому значению энтропии. И всё-таки, до конца не ясно, энтропия - допустимая мера хаоса или смерть Вселенной?

Энтропия в нашей жизни

В пику второму началу термодинамики, по положениям которого всё должно развиваться от сложного к простому, развитие земной эволюции продвигается в обратном направлении. Эта нестыковка обусловлена термодинамикой процессов, которые носят необратимый характер. Потребление живым организмом, если его представить как открытую термодинамическую систему, происходит в меньших объёмах, нежели выбрасывается из неё.

Пищевые вещества обладают меньшей энтропией, нежели произведённые из них продукты выделения. То есть, организм жив, потому что может выбросить эту меру хаоса, которая в нём вырабатывается в силу протекания необратимых процессов. К примеру, путём испарения из организма выводится около 170 г воды, т.е. тело человека компенсирует понижение энтропии некоторыми химическими и физическими процессами.

Энтропия – это некая мера свободного состояния системы. Она тем полнее, чем меньшие ограничения эта система имеет, но при условии, что степеней свободы у неё много. Получается, что нулевое значение меры хаоса – это полная информация, а максимальное – абсолютное незнание.

Вся наша жизнь – сплошная энтропия, потому что мера хаоса иногда превышает меру здравого смысла. Возможно, не так далеко время, когда мы придём ко второму началу термодинамики, ведь иногда кажется, что развитие некоторых людей, да и целых государств, уже пошло вспять, то есть, от сложного к примитивному.

Выводы

Энтропия – обозначение функции состояния физической системы, увеличение которой осуществляется за счёт реверсивной (обратимой) подачи тепла в систему;

величина внутренней энергии, которая не может быть преобразована в механическую работу;

точное определение энтропии производится посредством математических расчётов, при помощи которых устанавливается для каждой системы соответствующий параметр состояния (термодинамическое свойство) связанной энергии. Наиболее отчётливо энтропия проявляется в термодинамических процессах, где различают процессы, обратимые и необратимые, причём в первом случае энтропия остаётся неизменной, а во втором постоянно растёт, и это увеличение осуществляется за счёт уменьшения механической энергии.

Следовательно, все то множество необратимых процессов, которые происходят в природе, сопровождается уменьшением механической энергии, что в конечном итоге должно привести к остановке, к «тепловой смерти». Но этого не может произойти, поскольку с точки зрения космологии невозможно до конца завершить эмпирическое познание всей «целостности Вселенной», на основе которого наше представление об энтропии могло бы найти обоснованное применение. Христианские теологи полагают, что, основываясь на энтропии, можно сделать вывод о конечности мира и использовать её для доказательства «существования Бога». В кибернетике слово «энтропия» используется в смысле, отличном от его прямого значения, который лишь формально можно вывести из классического понятия; оно означает: среднюю наполненность информацией; ненадёжность в отношении ценности «ожидания» информации.

Довольно быстро вы поймете, что ничего у вас не получится, но не расстраивайтесь: вы не собрали кубик Рубика, зато проиллюстрировали второе начало термодинамики:

Энтропия изолированной системы не может уменьшаться.

Героиня фильма Вуди Аллена Whatever Works дает такое определение энтропии: это из-за чего тяжело засунуть обратно в тюбик зубную пасту. Она еще интересно объясняет принцип неопределенности Гейзенберга, еще один повод посмотреть фильм.

Энтропия - это мера беспорядка, хаоса. Вы пригласили друзей на новогоднюю вечеринку, прибрались, помыли пол, разложили на столе закуску, расставили напитки. Одним словом, все упорядочили и устранили столько хаоса, сколько смогли. Это система с маленькой энтропией.

Вы все, наверное, представляете, что происходит с квартирой, если вечеринка удалась: полный хаос. Зато у вас утром есть в распоряжении система с большой энтропией.

Для того, чтобы привести квартиру в порядок, надо прибраться, то есть потратить на это много энергии. Энтропия системы уменьшилась, но никакого противоречия со вторым началом термодинамики нет - вы же добавили энергию извне, и эта система уже не изолированная.

Неравный бой

Один из вариантов конца света - тепловая смерть Вселенной вследствие второго начала термодинамики. Энтропия вселенной достигнет своего максимума и ничего в ней больше происходить не будет.

В общем случае звучит все довольно уныло: в природе все упорядоченные вещи стремятся к разрушению, к хаосу. Но откуда тогда на Земле жизнь? Все живые организмы невероятно сложные и упорядоченные и каким-то образом всю свою жизнь борются с энтропией (хотя в конце концов она всегда побеждает).

Все очень просто. Живые организмы в процессе жизнедеятельности перераспределяют энтропию вокруг себя, то есть отдают свою энтропию всему, чему только могут. Например, когда мы едим бутерброд, то красивый упорядоченный хлеб с маслом мы превращаем известно во что. Получается, что свою энтропию мы отдали бутерброду, а в общей системе энтропия не уменьшилась.

А если взять Землю в целом, то она вообще не является замкнутой системой: Солнце снабжает нас энергией на борьбу с энтропией.

Важнейшим параметром состояния вещества является энтропия (S). Изменение энтропии в обратимом термодинамическом процессе определяется уравнением, являющимся аналитическим выражением второго закона термодинамики:

для 1 кг вещества - d s = d q / Т, где d q - бесконечно малое количество теплоты, подводимой или отводимой в элементарном процессе при температуре Т, кДж / кг.

Первым энтропию заметил Клаузиус (1876). Обнаружив в природе новую, ранее не известную никому величину Клаузиус назвал ее странным и непонятным словом «энтропия», которое сам и придумал. Он так объяснил его значение«тропе» по-гречески означает «превращение». К этому корню Клаузиус добавил две буквы – «эн», так чтобы получившееся слово было бы по возможности подобно слову «энергия». Обе величины настолько близки друг другу своей физической значимостью, что известное сходство в их названиях было целесообразно.

Энтропия - это производное понятие от понятия “состояние объекта” или “фазовое пространство объекта”. Она характеризует степень вариативности микросостояния объекта. Качественно, чем выше энтропия, тем в большем числе существенно различных микросостояний может находиться объект при данном макросостоянии.

Можно дать другое определение, не такое строгое и точное, но более наглядное: ЭНТРОПИЯ - это мера обесцененной энергии, бесполезной энергии, которую нельзя использовать для получения работы, или

ТЕПЛОТА - царица мира, ЭНТРОПИЯ - её тень.

Все реальные процессы, протекающие в действительности - необратимы. Их нельзя по желанию провести в прямом и обратном направлении, не оставив никакого следа в окружающем мире. Термодинамика должна помочь исследователям заранее узнать, пойдет ли реальный процесс, не осуществляя его в действительности. Для этого и нужно понятие «энтропия».

Энтропия - это свойство системы, которое полностью определяется состоянием системы. Какими бы путями не перешла система из одного состояния в другое, изменение её энтропии будет всегда одно и тоже.

Вычислить вообще энтропию системы или любого тела нельзя, как нельзя вообще определить его энергию. Вычислить можно только изменение энтропии при переходе системы из одного состояния в другое, если этот переход провести квазистатическим путём.

Специального названия для единиц, в которых измеряют энтропию, не придумано. Ее измеряют в Дж/кг*градус.

Уравнение Клаузиуса:

ΔS = S 2 – S 1 = ∑(Q/T) обратимый

Изменение энтропии при переходе системы из одного состояния в другое точно равно сумме приведенных теплот.

Энтропия - мера статистического беспорядка в замкнутой термодинамической системе. Чем больше порядка - тем меньше энтропия. И наоборот, чем меньше порядка - тем больше энтропия.

Все самопроизвольно протекающие процессы в замкнутой системе, приближающие систему к состоянию равновесия и сопровождающиеся ростом энтропии, направлены в сторону увеличения вероятности состояния (Больцман ).

Энтропия является функцией состояния, поэтому её изменение в термодинамическом процессе определяется только начальными и конечными значениями параметров состояния.

Изменение энтропии в основных термодинамических процессах определяется:

В изохорном DЅ v = С v ln Т 2 /Т 1

В изобарном DЅ р = С р ln Т 2 /Т 1

В изотермическом DЅ т = R ln Р 1 /Р 2 = R ln V 2 /V 1

Энтропия - это мера усложнения системы. Не беспорядка, а усложнения и развития. Чем больше энтропия, тем труднее понять логику этой конкретной системы, ситуации, явления. Принято считать, что чем больше проходит времени, тем менее упорядоченной становится Вселенная. Причина этого - неравномерная скорость развития Вселенной в целом и нас, как наблюдателей энтропии. Мы, как наблюдатели, являемся на огромное число порядков проще Вселенной. Поэтому она кажется нам чрезмерно избыточной, мы не в состоянии понять большинство причинно-следственных связей, её составляющих. Важен и психологический аспект - людям трудно свыкнуться с тем, что они не уникальны. Поймите, тезис о том, что люди - венец эволюции, недалеко ушёл от более раннего убеждения в том, что Земля является центром мироздания. Человеку приятно верить в свою исключительность и неудивительно, что структуры, которые сложнее нас, мы склонны видеть беспорядочными и хаотическими.

Выше есть очень хорошие ответы, объясняющие энтропию, исходя из современной научной парадигмы. На простых примерах отвечающие объясняют это явление. Разбросанные по комнате носки, разбитые стаканы, игра обезьян в шахматы и т.д. Но если приглядеться, то понимаешь - порядок здесь выражается в истинно человеческом представлении. К доброй половине таких примеров применимо слово "лучше". Лучше сложенные в шкафу носки, чем разбросанные носки на полу. Лучше целый стакан, чем стакан разбитый. Тетрадь, написанная красивым почерком лучше тетради с кляксами. В человеческой логике непонятно, что делать с энтропией. Дым, вылетающий из трубки не утилитарен. Разорванная на мелкие кусочки книга бесполезна. Из многоголосого говора и шума в метро трудно выудить хотя бы минимум информации. В этом смысле очень интересным будет вернуться к определению энтропии, введённому физиком и математиком Рудольфом Клаузиусом, видевшему это явление, как меру необратимого рассеяния энергии. От кого уходит эта энергия? Кому становится труднее ей воспользоваться? Да человеку же! Пролитую воду очень трудно (если не невозможно) всю, до капли снова собрать в стакан. Чтобы починить старую одежду, нужно воспользоваться новым материалом (тканью, нитками и т.д.). При этом не учитывается смысл, который данная энтропия может нести не для людей. Приведу пример, когда рассеяние энергии для нас будет нести прямо противоположный смысл для другой системы:

Вы знаете, что ежесекундно огромное количество информации с нашей планеты улетает в космос. Например, в виде радиоволн. Для нас эта информация кажется абсолютно потерянной. Но если на пути радиоволн окажется достаточно развитая инопланетная цивилизация, её представители могут принять и расшифровать часть этой потерянной для нас энергии. Услышать и понять наши голоса, увидеть наши телевизионные и радио передачи, подключиться к нашему интернет-траффику))). В таком случае, нашу энтропию могут упорядочить другие разумные существа. И чем больше рассеяние энергии будет для нас, тем больше энергии смогут собрать они.